¿Qué encontraremos en este artículo?

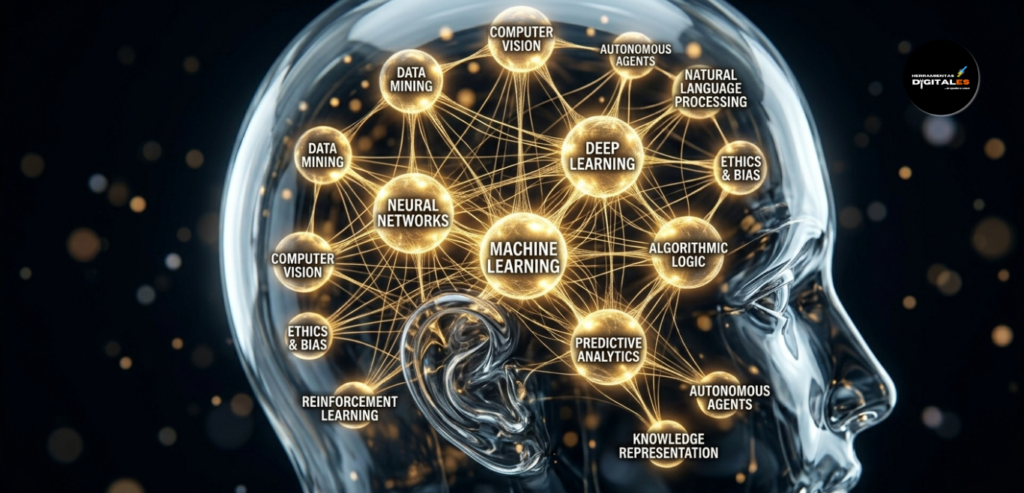

Estamos viviendo la mayor transformación tecnológica de la historia. La Inteligencia Artificial ha dejado de ser una promesa de ciencia ficción para convertirse en el tejido que conecta nuestra economía, nuestra ciencia y nuestra vida diaria. Desde la simplicidad de un algoritmo de búsqueda hasta el abismo teórico de la superinteligencia, entender sus componentes no es solo una ventaja competitiva, es una necesidad. En esta completa guía de inteligencia artificial, exploramos los pilares fundamentales que están esculpiendo el futuro de la humanidad.

Machine Learning: La revolución de la inteligencia artificial

El Machine Learning (ML), o aprendizaje automático, es una de las ramas más fascinantes y revolucionarias de la inteligencia artificial (IA). Su capacidad para aprender y mejorar automáticamente a partir de datos lo ha convertido en una herramienta esencial en múltiples industrias, desde la tecnología hasta la medicina. En este artículo, exploraremos qué es el Machine Learning, cómo funciona, sus aplicaciones y por qué está transformando el mundo.

¿Qué es Machine Learning?

El Machine Learning es un subcampo de la inteligencia artificial que permite a las máquinas aprender de los datos sin necesidad de ser programadas explícitamente. En lugar de seguir instrucciones predefinidas, los algoritmos de ML analizan patrones en los datos y hacen predicciones o toman decisiones basadas en ellos.

¿Cómo funciona?

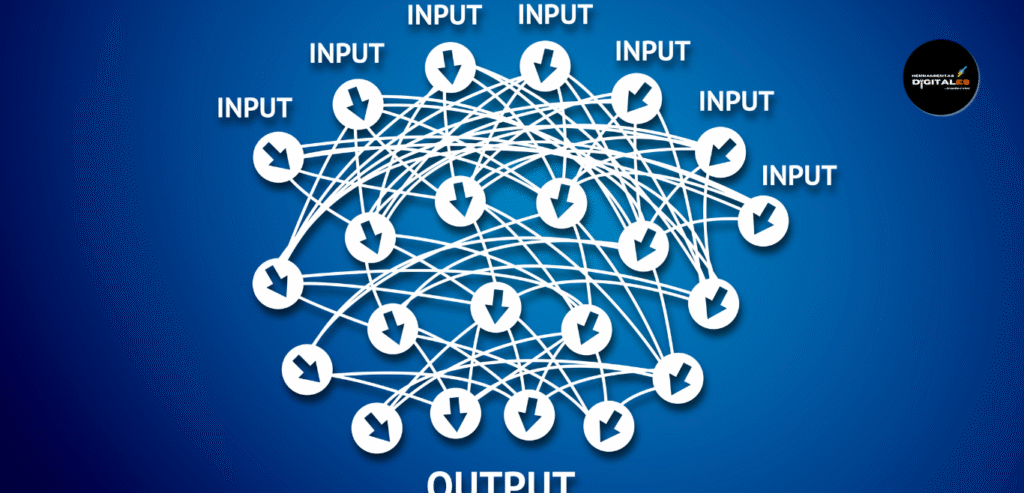

El proceso de Machine Learning se basa en tres pasos principales:

Entrenamiento: El algoritmo se alimenta con un conjunto de datos (dataset) para identificar patrones y relaciones.

Validación: Se evalúa el modelo con datos nuevos para medir su precisión.

Predicción: Una vez entrenado, el modelo puede hacer predicciones o clasificaciones basadas en datos futuros.

Existen diferentes tipos de aprendizaje automático

Aprendizaje supervisado: El modelo aprende a partir de datos etiquetados (por ejemplo, imágenes clasificadas como «gato» o «perro»).

Aprendizaje no supervisado: El modelo identifica patrones en datos no etiquetados (como segmentar clientes en grupos).

Aprendizaje por refuerzo: El modelo aprende a través de prueba y error, recibiendo recompensas por decisiones correctas.

Aplicaciones del Machine Learning

El Machine Learning está presente en nuestra vida diaria, a menudo sin que nos demos cuenta. Algunas de sus aplicaciones más comunes incluyen:

Motores de recomendación: Plataformas como Netflix, Amazon y Spotify utilizan ML para sugerir contenido personalizado.

Reconocimiento de voz y texto: Asistentes virtuales como Siri o Alexa dependen de ML para entender y responder a comandos.

Detección de fraudes: Los bancos usan ML para identificar transacciones sospechosas.

Medicina: Ayuda en el diagnóstico de enfermedades y en la personalización de tratamientos.

Automóviles autónomos: Los vehículos utilizan ML para interpretar su entorno y tomar decisiones en tiempo real.

Ventajas y desafíos

Ventajas

Automatización de tareas repetitivas.

Mejora en la precisión de predicciones.

Capacidad de procesar grandes volúmenes de datos.

Desafíos

Necesidad de grandes cantidades de datos de calidad.

Riesgo de sesgos en los modelos.

Complejidad en la interpretación de resultados.

El horizonte de un mundo redefinido por el aprendizaje

El Machine Learning no es solo una tendencia tecnológica; es una herramienta que está redefiniendo cómo interactuamos con el mundo. Desde mejorar la experiencia del usuario hasta resolver problemas complejos, su impacto es innegable. Sin embargo, también plantea desafíos éticos y técnicos que deben abordarse para garantizar su uso responsable.

El futuro del Machine Learning es prometedor, y su evolución continuará transformando industrias y mejorando nuestras vidas. Si estás interesado en aprender más, este es el momento perfecto para sumergirte en este apasionante campo.

Aprendizaje No Supervisado: Explorando lo desconocido en los datos

El Aprendizaje No Supervisado es una técnica clave dentro del campo del Aprendizaje Automático (Machine Learning) que permite a los modelos identificar patrones y estructuras ocultas en datos no etiquetados. A diferencia del Aprendizaje Supervisado, este enfoque no requiere datos con salidas predefinidas, lo que lo convierte en una herramienta poderosa para el análisis exploratorio y la comprensión de datos complejos. En este artículo, profundizaremos en qué es el Aprendizaje No Supervisado, cómo funciona, sus aplicaciones y su impacto en la tecnología moderna.

¿Qué es el Aprendizaje No Supervisado?

El Aprendizaje No Supervisado es un método de Machine Learning en el que los algoritmos trabajan con datos no etiquetados. Esto significa que el modelo no tiene información previa sobre las salidas correctas y debe descubrir patrones, relaciones o agrupaciones por sí mismo. Este enfoque es ideal para tareas donde no se dispone de datos etiquetados o donde el objetivo es explorar y comprender mejor los datos.

¿Cómo funciona?

El Aprendizaje No Supervisado se basa en algoritmos que analizan los datos y encuentran similitudes o diferencias para organizarlos en grupos o estructuras. Los dos enfoques principales son:

Clustering (Agrupamiento): Los datos se agrupan en clústeres basados en sus características similares. Ejemplo: segmentar clientes según su comportamiento de compra.

Reducción de dimensionalidad: Simplifica conjuntos de datos complejos al reducir el número de variables, manteniendo la información más relevante. Ejemplo: compresión de imágenes o visualización de datos.

Aplicaciones del Aprendizaje No Supervisado

El Aprendizaje No Supervisado tiene aplicaciones prácticas en una amplia variedad de campos, incluyendo:

Segmentación de clientes: Identificar grupos de clientes con comportamientos similares para personalizar estrategias de marketing.

Detección de anomalías: Identificar patrones inusuales en datos, como fraudes financieros o fallos en sistemas industriales.

Reconocimiento de imágenes: Clasificar imágenes o identificar patrones visuales en grandes conjuntos de datos.

Análisis genómico: Descubrir relaciones entre genes o identificar subgrupos en datos biológicos.

Recomendadores de contenido: Sugerir productos o servicios basados en patrones de comportamiento del usuario.

Ventajas y desafíos

Ventajas

No requiere datos etiquetados, lo que reduce costos y tiempo.

Ideal para explorar datos desconocidos o complejos.

Puede descubrir patrones ocultos que no son evidentes a simple vista.

Desafíos

Los resultados pueden ser difíciles de interpretar sin un contexto claro.

Mayor riesgo de obtener patrones irrelevantes o sesgados.

Requiere experiencia para seleccionar el algoritmo adecuado y ajustar los parámetros.

Hacia la autonomía en el descubrimiento de patrones ocultos

El aprendizaje no supervisado es una herramienta esencial para analizar y comprender datos no etiquetados. Su capacidad para descubrir patrones ocultos lo convierte en un aliado poderoso en campos como el marketing, la medicina y la tecnología. Sin embargo, su éxito depende de la calidad de los datos y de la experiencia en la selección y ajuste de algoritmos.

A medida que el volumen de datos sigue creciendo, el aprendizaje no supervisado jugará un papel cada vez más importante en la toma de decisiones basada en datos. Es una técnica que no solo amplía los límites del Machine Learning, sino que también abre nuevas posibilidades para resolver problemas complejos en el mundo real.

Aprendizaje Supervisado: La base del Machine Learning

El aprendizaje supervisado es una de las técnicas más utilizadas dentro del campo del aprendizaje automático (Machine Learning). Su capacidad para aprender a partir de datos etiquetados lo convierte en una herramienta poderosa para resolver problemas del mundo real, desde la clasificación de correos electrónicos hasta la predicción de valores financieros. En este artículo, exploraremos qué es el aprendizaje supervisado, cómo funciona, sus aplicaciones y su impacto en la tecnología actual.

¿Aprendizaje Supervisado o Machine Learning? entendiendo la diferencia

Es común confundir estos dos conceptos porque el aprendizaje supervisado es, de hecho, un subtipo de Machine Learning. Sin embargo, aquí está la diferencia clave:

Machine Learning: Es un campo amplio dentro de la inteligencia artificial que abarca todas las técnicas y enfoques que permiten a las máquinas aprender de datos sin ser programadas explícitamente. Incluye varios subtipos, como el aprendizaje supervisado, el no supervisado y el aprendizaje por refuerzo.

Aprendizaje Supervisado: Es un método específico dentro del Machine Learning. Se caracteriza por el uso de datos etiquetados durante el proceso de entrenamiento. Esto significa que cada entrada tiene una salida conocida (por ejemplo, imágenes etiquetadas con «gato» o «perro»), lo que permite al modelo aprender con mayor precisión para luego hacer predicciones.

Podemos resumir que Machine Learning es el «todo» (la disciplina), mientras que el aprendizaje supervisado es una «parte» (una técnica específica). Mientras que el Machine Learning puede incluir enfoques que no requieren datos etiquetados (como el aprendizaje no supervisado), el aprendizaje supervisado se centra exclusivamente en tareas en las que se cuenta con datos etiquetados.

Ahora sí, profundicemos sobre el Aprendizaje Supervisado:

¿Qué es el Aprendizaje Supervisado?

El aprendizaje supervisado es un enfoque del Machine Learning en el que un modelo aprende a partir de un conjunto de datos etiquetados. Esto significa que cada entrada en el conjunto de datos tiene una salida correspondiente conocida (por ejemplo, una imagen etiquetada como «gato» o «perro»). El objetivo del modelo es aprender una función que relacione las entradas con las salidas para poder hacer predicciones precisas sobre datos nuevos.

¿Cómo funciona?

El proceso de aprendizaje supervisado se divide en varias etapas clave:

Conjunto de entrenamiento: Se proporciona al modelo un conjunto de datos etiquetados que contiene ejemplos de entrada y sus salidas correspondientes.

Entrenamiento del modelo: El modelo analiza los datos y ajusta sus parámetros internos para minimizar el error entre las predicciones y las salidas reales.

Validación y pruebas: Una vez entrenado, el modelo se evalúa con datos nuevos para medir su precisión y capacidad de generalización.

Predicción: Finalmente, el modelo se utiliza para hacer predicciones sobre datos desconocidos.

Tipos de problemas en Aprendizaje Supervisado

El aprendizaje supervisado se aplica principalmente a dos tipos de problemas:

Clasificación: El objetivo es asignar una etiqueta a cada entrada. Ejemplos incluyen la detección de spam en correos electrónicos o la clasificación de imágenes.

Regresión: Se busca predecir un valor numérico continuo, como el precio de una vivienda o la temperatura de un día específico.

Aplicaciones del Aprendizaje Supervisado

El aprendizaje supervisado tiene aplicaciones en una amplia variedad de campos:

Reconocimiento de imágenes: Identificación de objetos, rostros o escenas en fotografías.

Procesamiento de Lenguaje Natural (NLP): Traducción automática, análisis de sentimientos y chatbots.

Finanzas: Predicción de precios de acciones y evaluación de riesgos crediticios.

Medicina: Diagnóstico de enfermedades a partir de imágenes médicas o datos clínicos.

Marketing: Segmentación de clientes y personalización de campañas publicitarias.

Ventajas y desafíos

Ventajas

Alta precisión en tareas específicas.

Capacidad de automatizar procesos complejos.

Aplicaciones prácticas en múltiples industrias.

Desafíos

Requiere grandes cantidades de datos etiquetados, lo cual puede ser costoso y laborioso.

Puede ser susceptible a sesgos en los datos, lo que afecta la calidad de las predicciones.

Limitaciones en la generalización a situaciones completamente nuevas.

La precisión del conocimiento guiado

El aprendizaje supervisado es una herramienta fundamental en el desarrollo de soluciones basadas en inteligencia artificial. Su capacidad para aprender de datos etiquetados lo hace ideal para resolver problemas específicos con alta precisión. Sin embargo, también plantea desafíos relacionados con la calidad y cantidad de datos necesarios. A medida que la tecnología avanza, el aprendizaje supervisado seguirá desempeñando un papel crucial en la transformación de industrias y en la mejora de nuestras vidas.

Aprendizaje por Refuerzo: La inteligencia artificial que aprende con recompensas

El aprendizaje por refuerzo (Reinforcement Learning, RL) es una técnica avanzada dentro del aprendizaje automático que permite a los sistemas aprender a tomar decisiones óptimas a través de un proceso de prueba y error. Inspirado en la psicología conductista, este enfoque utiliza un esquema de recompensas y penalizaciones para guiar a un agente hacia el logro de un objetivo. En este artículo, exploraremos cómo funciona, sus aplicaciones y por qué es una de las áreas más emocionantes de la inteligencia artificial.

¿Qué es el Aprendizaje por Refuerzo?

El aprendizaje por refuerzo es un método de Machine Learning en el que un agente interactúa con un entorno, toma decisiones y recibe retroalimentación en forma de recompensas o penalizaciones. El objetivo del agente es maximizar la recompensa acumulada a lo largo del tiempo, aprendiendo una estrategia óptima para actuar en diferentes situaciones.

A diferencia del aprendizaje supervisado, donde el modelo aprende a partir de datos etiquetados, en el aprendizaje por refuerzo no hay una «respuesta correcta» explícita. En su lugar, el agente debe explorar y descubrir qué acciones conducen a mejores resultados.

¿Cómo funciona?

El aprendizaje por refuerzo se basa en los siguientes componentes clave:

Agente: Es la entidad que toma decisiones.

Entorno: Es el escenario en el que el agente opera.

Estado: Representa la situación actual del entorno.

Acción: Es la decisión que toma el agente en un estado dado.

Recompensa: Es la retroalimentación que recibe el agente después de realizar una acción.

Política: Es la estrategia que sigue el agente para decidir sus acciones.

Función de valor: Evalúa la utilidad esperada de un estado o acción a largo plazo.

El proceso de aprendizaje implica un equilibrio entre exploración (probar nuevas acciones para descubrir mejores recompensas) y explotación (usar el conocimiento actual para maximizar las recompensas).

Aplicaciones del Aprendizaje por Refuerzo

El aprendizaje por refuerzo tiene aplicaciones en una amplia variedad de campos, incluyendo:

Robótica: Enseñar a robots a realizar tareas complejas, como ensamblar piezas o navegar en entornos desconocidos.

Juegos: Desarrollar agentes que puedan jugar y ganar en videojuegos o juegos de mesa, como el famoso caso de AlphaGo.

Vehículos autónomos: Ayudar a los coches autónomos a tomar decisiones en tiempo real, como evitar obstáculos o planificar rutas.

Optimización de procesos: Mejorar la eficiencia en sistemas industriales, como la gestión de energía o la logística.

Atención médica: Personalizar tratamientos médicos basados en la retroalimentación del paciente.

Ventajas y desafíos

Ventajas

Capacidad para resolver problemas complejos con múltiples variables.

No requiere datos etiquetados, lo que reduce costos en ciertas aplicaciones.

Aprende de manera continua y mejora con el tiempo.

Desafíos

Requiere una gran cantidad de interacciones con el entorno, lo que puede ser costoso o lento.

Puede ser difícil de implementar en entornos reales debido a su complejidad.

Riesgo de sobreajuste si el agente se enfoca demasiado en maximizar recompensas a corto plazo.

El camino de la mejora continua mediante la experiencia

El aprendizaje por refuerzo es una de las áreas más prometedoras de la inteligencia artificial, con el potencial de transformar industrias y resolver problemas complejos. Su enfoque basado en recompensas y penalizaciones lo hace ideal para tareas donde la toma de decisiones es clave. Sin embargo, también plantea desafíos técnicos y éticos que deben abordarse para garantizar su implementación responsable.

A medida que la tecnología avanza, el aprendizaje por refuerzo seguirá desempeñando un papel crucial en el desarrollo de sistemas inteligentes que puedan adaptarse y aprender en entornos dinámicos.

Modelos Predictivos: La herramienta clave de la IA para anticipar el futuro

En el mundo moderno, donde los datos son considerados el nuevo oro, los modelos predictivos han emergido como herramientas esenciales para extraer valor significativo de la información. Desde predecir el comportamiento de los consumidores hasta anticipar fallos en máquinas industriales, los modelos predictivos están revolucionando la forma en que las organizaciones toman decisiones estratégicas.

En este artículo, exploraremos qué son los modelos predictivos, cómo funcionan, sus principales aplicaciones, los algoritmos más utilizados y su importancia en diversos sectores.

¿Qué son los modelos predictivos?

Los modelos predictivos son algoritmos o sistemas basados en inteligencia artificial y análisis estadístico que tienen como objetivo predecir eventos futuros o resultados desconocidos. Esto se realiza utilizando datos históricos para identificar patrones y tendencias que permitan anticiparse a posibles escenarios.

En esencia, los modelos predictivos responden preguntas como:

¿Qué pasará si se mantiene esta tendencia?

¿Cómo se comportará este cliente en el futuro?

¿Qué riesgos podrían surgir en el próximo periodo?

Cómo funcionan los modelos predictivos

El proceso de los modelos predictivos implica varias etapas clave:

Recolección de datos: Se recopilan datos históricos y actuales de diversas fuentes, como bases de datos internas, sensores, redes sociales y más.

Limpieza y preparación de datos: Los datos se filtran, se corrigen errores y se estandarizan para garantizar precisión.

Entrenamiento del modelo: Utilizando algoritmos de machine learning, se entrena el modelo con los datos para identificar patrones relevantes.

Validación y pruebas: El modelo se evalúa en conjuntos de datos separados para comprobar su capacidad predictiva.

Generación de predicciones: Una vez validado, el modelo se utiliza para predecir resultados basados en nuevos datos.

Principales algoritmos utilizados

Existen múltiples algoritmos que sustentan los modelos predictivos, cada uno adecuado para diferentes tipos de datos y objetivos. Algunos de los más comunes incluyen:

Regresión lineal: Útil para predecir valores continuos, como ingresos o temperaturas.

Árboles de decisión: Ideales para clasificaciones y análisis más intuitivos.

Random Forest: Combina múltiples árboles de decisión para mejorar la precisión.

Redes Neuronales Artificiales (ANN): Utilizadas para detectar patrones complejos en datos no lineales.

Máquinas de Vectores de Soporte (SVM): Útiles en clasificaciones y predicciones con márgenes claros.

K-Means: Algoritmo de agrupamiento para segmentar datos en clusters.

Aplicaciones prácticas de los modelos predictivos

Los modelos predictivos tienen aplicaciones en prácticamente todas las industrias. Algunos ejemplos destacados son:

Negocios y marketing

Previsión de ventas basadas en el comportamiento del mercado.

Predicción de abandono de clientes y estrategias de retención.

Personalización de campañas publicitarias.

Salud y medicina

Detección temprana de enfermedades a través del análisis de datos clínicos.

Predicción de epidemias o brotes en función de patrones históricos.

Optimización de recursos hospitalarios.

Finanzas

Evaluación de riesgos crediticios.

Predicción de fraudes en transacciones bancarias.

Análisis de inversiones y tendencias de mercado.

Manufactura e industria

Anticipación de fallos en máquinas mediante sensores y mantenimiento predictivo.

Optimización de líneas de producción.

Transporte y logística

Predicción de tiempos de entrega.

Modelos de tráfico y optimización de rutas.

Importancia de los modelos predictivos

La relevancia de los modelos predictivos radica en su capacidad para:

Mejorar la toma de decisiones: Proporcionan información basada en datos reales, reduciendo incertidumbres.

Reducir costes: Permiten actuar proactivamente ante posibles problemas.

Aumentar la eficiencia: Optimizan procesos operativos mediante predicciones precisas.

Personalizar experiencias: Adaptan productos y servicios a las necesidades futuras de los usuarios.

Retos y limitaciones

A pesar de su potencial, los modelos predictivos enfrentan desafíos como:

Calidad de los datos: Datos incompletos o sesgados pueden afectar la precisión.

Sobrefitting (Sobreajuste): Cuando el modelo se adapta demasiado a los datos de entrenamiento, perdiendo capacidad de generalización.

Interpretabilidad: Algunos algoritmos, como las redes neuronales, son difíciles de interpretar, lo que limita la confianza de los usuarios.

Seguridad y ética: Predicciones erróneas pueden tener consecuencias graves en ciertos contextos (por ejemplo, en salud o finanzas).

La visión estratégica en la era del Big Data

Los modelos predictivos son herramientas indispensables para la toma de decisiones en un mundo impulsado por datos. Desde prever comportamientos hasta optimizar procesos, su impacto es evidente en múltiples industrias. Sin embargo, su éxito depende de la calidad de los datos, los algoritmos utilizados y la interpretación adecuada de sus resultados.

Al incorporar modelos predictivos de manera estratégica y responsable, las organizaciones pueden obtener ventajas competitivas y estar mejor preparadas para enfrentar los desafíos del futuro. La clave está en la combinación de tecnología, talento humano y ética para aprovechar al máximo estas poderosas herramientas.

Inteligencia Artificial Estrecha (Narrow AI): La IA especializada que transforma el mundo

La Inteligencia Artificial Estrecha (Narrow AI) es el tipo de inteligencia artificial más desarrollado y utilizado en la actualidad. A diferencia de la Inteligencia Artificial General (AGI), que busca imitar la capacidad de razonamiento humano en múltiples áreas, la Narrow AI está diseñada para realizar tareas específicas con una precisión y eficiencia superiores a las de los humanos en ciertos ámbitos.

Este artículo explorará qué significa la Inteligencia Artificial Estrecha, qué implica, en qué parte del ecosistema de IA se encuentra, dónde se aplica y por qué es tan importante para la evolución tecnológica.

¿Qué es la Inteligencia Artificial Estrecha (Narrow AI)?

La Inteligencia Artificial Estrecha se define como sistemas de IA diseñados para realizar tareas específicas sin poseer capacidades generales de pensamiento o razonamiento. Estos modelos no pueden aprender o desempeñar funciones fuera de su propósito programado.

Ejemplos comunes incluyen:

Asistentes Virtuales como Siri, Alexa o Google Assistant.

Sistemas de Reconocimiento Facial utilizados en seguridad y dispositivos móviles.

Motores de Recomendación de plataformas como Netflix y Spotify.

Automatización Industrial en fábricas y procesos de manufactura.

A diferencia de la IA general o la Superinteligencia Artificial (ASI), la Narrow AI no puede pensar o tomar decisiones de forma autónoma fuera de sus parámetros establecidos. Su eficacia radica en su especialización y optimización para una tarea concreta.

¿Qué implica la Inteligencia Artificial Estrecha?

La IA Estrecha implica el desarrollo de algoritmos avanzados y modelos de aprendizaje automático que permiten a las máquinas realizar tareas con gran eficiencia. Algunas de sus características incluyen:

Uso de grandes volúmenes de datos para mejorar su desempeño.

Entrenamiento específico con modelos supervisados y no supervisados.

Dependencia de la programación humana para definir sus parámetros y objetivos.

Limitaciones en la adaptabilidad fuera de su función programada.

En términos prácticos, la Narrow AI se basa en la aplicación de tecnologías como aprendizaje automático (Machine Learning), aprendizaje profundo (Deep Learning) y procesamiento de lenguaje natural (NLP).

¿Qué parte de la IA representa?

La IA Estrecha forma la base del desarrollo actual de inteligencia artificial y representa la etapa más avanzada aplicada en la vida cotidiana. Se ubica dentro del espectro de la IA como:

IA Estrecha (Narrow AI) → Especializada en tareas específicas.

IA General (AGI) → Capaz de razonar de manera similar a los humanos.

Superinteligencia Artificial (ASI) → Hipotética inteligencia superior a la humana.

Hoy en día, todos los sistemas de IA con impacto comercial y práctico operan bajo el concepto de IA Estrecha.

¿Dónde se aplica la Inteligencia Artificial Estrecha?

La IA Estrecha se encuentra en múltiples sectores y revoluciona la forma en que operan industrias completas. Algunas de sus aplicaciones incluyen:

Medicina y salud

Diagnóstico asistido por IA en enfermedades como cáncer y afecciones cardíacas.

Análisis de imágenes médicas mediante visión por computadora.

Robots quirúrgicos guiados por algoritmos de IA.

Desarrollo de fármacos basado en modelos predictivos.

Finanzas

Detección de fraudes bancarios mediante sistemas de aprendizaje automático.

Automatización de asesoramiento financiero basado en datos del mercado.

Análisis de riesgos de inversión con modelos predictivos.

Seguridad y defensa

Reconocimiento facial en aeropuertos y centros de seguridad.

Análisis de amenazas cibernéticas mediante IA robusta.

Monitoreo de actividades sospechosas con sistemas automatizados.

Industria y manufactura

Optimización de procesos de producción mediante automatización avanzada.

Mantenimiento predictivo de maquinaria con sensores de IA.

Control de calidad automatizado con aprendizaje profundo.

Transporte y movilidad

Sistemas de conducción autónoma en vehículos inteligentes.

IA en logística para mejorar la eficiencia en rutas y entregas.

Predicción del tráfico basada en datos históricos.

Comercio y marketing

Motores de recomendación en plataformas de comercio electrónico.

Chatbots de atención al cliente que mejoran la interacción con usuarios.

Publicidad personalizada basada en análisis de comportamiento del consumidor.

Importancia de la Inteligencia Artificial Estrecha

La IA Estrecha es fundamental en la evolución tecnológica debido a su capacidad para optimizar procesos y mejorar la eficiencia en múltiples sectores. Su importancia radica en:

Automatización de tareas repetitivas que ahorran tiempo y costos.

Incremento en la precisión y calidad de diagnósticos y servicios.

Optimización del uso de datos para mejorar la toma de decisiones.

Mayor accesibilidad tecnológica en aplicaciones comerciales y personales.

Seguridad y reducción de errores en industrias críticas como salud y finanzas.

Si bien la IA Estrecha no posee capacidades generales de pensamiento, su especialización y enfoque en tareas específicas han revolucionado el mundo de los negocios, la ciencia y la vida cotidiana.

El motor invisible que impulsa nuestra realidad actual

La Inteligencia Artificial Estrecha (Narrow AI) es la forma más avanzada y utilizada de IA en la actualidad. Desde asistentes virtuales hasta diagnósticos médicos automatizados, su impacto es profundo y en constante expansión.

Aunque su alcance está limitado a tareas específicas, el desarrollo continuo de esta tecnología está allanando el camino para la futura evolución de la IA General (AGI) y, eventualmente, la Superinteligencia Artificial (ASI).

El desafío para el futuro será garantizar que su implementación sea ética, segura y utilizada para mejorar la calidad de vida sin generar riesgos innecesarios. Sin duda, la IA Estrecha es el motor actual de la revolución tecnológica, permitiendo que empresas e individuos aprovechen el potencial del aprendizaje automático para transformar su realidad.

Inteligencia Artificial General (AGI): La próxima frontera de la tecnología

La Inteligencia Artificial General (AGI, por sus siglas en inglés), también conocida como IA General, representa uno de los mayores desafíos y ambiciones en el campo de la inteligencia artificial. A diferencia de la Inteligencia Artificial Estrecha (Narrow AI), que se enfoca en tareas específicas, la AGI busca emular la inteligencia humana de manera global, siendo capaz de aprender, razonar, adaptarse y realizar cualquier tarea cognitiva con un nivel similar al de un ser humano.

En este artículo, exploraremos qué es la AGI, qué implica su desarrollo, cómo se posiciona dentro del ecosistema de la IA, sus posibles aplicaciones futuras y la importancia que podría tener en nuestra sociedad.

¿Qué es la Inteligencia Artificial General (AGI)?

La Inteligencia Artificial General se refiere a sistemas de IA que no solo son expertos en una tarea específica, sino que tienen la capacidad de comprender, razonar y resolver problemas en cualquier dominio, al igual que un ser humano. En otras palabras, una AGI sería capaz de:

Aprender de la experiencia y adaptarse a nuevos contextos.

Tomar decisiones complejas sin intervención humana.

Resolver problemas para los que no fue previamente entrenada.

Pensar creativamente e incluso tener auto – conciencia, dependiendo de su nivel de desarrollo.

Actualmente, la AGI permanece como un objetivo teórico, y ninguna tecnología de IA ha logrado alcanzar este nivel de sofisticación.

¿Qué implica el desarrollo de la AGI?

El desarrollo de la AGI plantea importantes implicaciones tanto técnicas como éticas:

Implicaciones técnicas

Conocimiento multidisciplinario: Una AGI debería tener capacidades en múltiples disciplinas, desde matemáticas hasta lenguaje, creatividad y resolución de problemas abstractos.

Capacidad de razonamiento general: Esto incluye habilidades de análisis crítico, deducción y razonamiento lógico.

Sistemas autónomos: Deberían ser capaces de operar de forma independiente, sin depender de reglas predefinidas.

Procesamiento similar al humano: La AGI necesitaría capacidades similares a las de un cerebro humano, pero con una capacidad de procesamiento infinitamente mayor.

Implicaciones éticas

Control y supervisión: ¿Cómo aseguramos que la AGI actuará de manera alineada con los valores humanos?

Impacto social: Su desarrollo podría transformar profundamente la economía, la política y la estructura social.

Riesgos potenciales: Una AGI mal gestionada podría plantear amenazas graves si no se controla adecuadamente.

¿Qué parte del ecosistema de la IA representa la AGI?

En el espectro de la inteligencia artificial, la AGI se posiciona como la próxima evolución tras la IA Estrecha (Narrow AI). El progreso del ecosistema se organiza de esta forma:

IA Estrecha (Narrow AI): Especializada en tareas específicas (como los chatbots o los sistemas de recomendación).

IA General (AGI): Capaz de realizar cualquier tarea cognitiva, con una comprensión universal similar a la humana.

Superinteligencia Artificial (ASI): Un nivel teórico en el que la inteligencia de las máquinas supera a la humana en todos los aspectos.

Aunque la AGI es todavía una meta futura, los avances en la IA estrecha y los sistemas actuales de aprendizaje profundo son pasos fundamentales hacia este objetivo.

¿Dónde podría aplicarse la AGI?

Aunque la AGI no es una realidad en el presente, su potencial aplicación abarcaría prácticamente todos los campos de la sociedad. Aquí algunos ejemplos de lo que podría lograrse:

Salud y medicina

Diagnósticos médicos completamente autónomos y personalizados.

Creación acelerada de medicamentos y vacunas.

Cirugías realizadas por robots autónomos con precisión sobrehumana.

Educación

Sistemas educativos capaces de adaptarse al estilo de aprendizaje de cada estudiante.

Generación de materiales educativos en tiempo real basados en las necesidades del alumno.

Ciencia e investigación

Resolución de problemas complejos como el cambio climático o la fusión nuclear.

Descubrimientos científicos en áreas como la biología y la física cuántica.

Tecnología y automatización

Creación de sistemas de IA capaces de mejorar y evolucionar sus propios algoritmos.

Innovaciones sin precedentes en robótica y software.

Economía y trabajo

Optimización integral de procesos empresariales.

Gestión eficiente de recursos a nivel global, desde energía hasta alimentos.

Importancia de la AGI

La AGI representa una revolución potencial en nuestra forma de interactuar con la tecnología. Entre las razones por las que es clave destacan:

Capacidad de resolver problemas globales: Una AGI podría abordar desafíos complejos que requieren análisis masivos de datos, como pandemias o desastres naturales.

Transformación de la economía: Automatizaría procesos a niveles nunca antes vistos, reduciendo costos y aumentando la productividad.

Innovación científica: El avance en investigación y desarrollo podría acelerarse exponencialmente.

Interacción humano-máquina mejorada: Una AGI facilitaría la convivencia entre humanos y tecnología, haciéndola más intuitiva y accesible.

Sin embargo, su desarrollo también implica una gran responsabilidad, ya que un mal manejo de la AGI podría tener consecuencias irreversibles en nuestra sociedad.

El desafío ético de la conciencia artificial

La Inteligencia Artificial General (AGI) es el santo grial del campo de la inteligencia artificial, representando un avance que podría redefinir la humanidad tal como la conocemos. Aunque su desarrollo aún se encuentra en una etapa conceptual, la investigación en IA estrecha y sistemas de aprendizaje profundo está allanando el camino para su posible realización.

No obstante, los desafíos técnicos y éticos asociados con la AGI son enormes. Desde garantizar su alineación con los valores humanos hasta prever su impacto en la sociedad, el futuro de la AGI dependerá de una colaboración global entre científicos, tecnólogos, legisladores y la sociedad en general.

El futuro de la AGI no está únicamente en manos de los desarrolladores, sino en la visión compartida de construir un mundo donde la tecnología y la humanidad coexistan en armonía.

Algoritmos: Qué son y por qué importan en tecnología

Los algoritmos están presentes en nuestra vida diaria, desde las recomendaciones de series en plataformas como Netflix y YouTube hasta las búsquedas en Google. Son la base de la informática y juegan un papel esencial en el desarrollo de la inteligencia artificial, la automatización y la toma de decisiones. En este artículo, exploraremos qué es un algoritmo, cómo se genera, cómo funciona, su importancia y sus aplicaciones en diversos campos.

¿Qué es un algoritmo?

Un algoritmo es un conjunto de instrucciones ordenadas que permiten resolver un problema o realizar una tarea específica. Funciona como una receta de cocina: sigue pasos precisos para obtener un resultado deseado.

Ejemplo sencillo de algoritmo:

Cómo hacer una taza de café

1. Hervir agua.

2. Colocar café molido en una taza.

3. Verter el agua caliente sobre el café.

4. Revolver y añadir azúcar o leche si se desea.

En informática, los algoritmos permiten a las computadoras procesar información de manera eficiente y automática.

¿Cómo se generan los algoritmos?

La creación de un algoritmo pasa por varias fases:

Definición del problema: Se identifica qué se quiere solucionar.

Diseño de pasos lógicos: Se estructuran las instrucciones en un orden lógico.

Implementación en código: Se traduce el algoritmo a un lenguaje de programación.

Pruebas y optimización: Se ajusta el código para mejorar su eficiencia.

Los algoritmos pueden ser simples, como los que organizan una lista de números en orden, o complejos, como los que impulsan la inteligencia artificial y el análisis de datos.

¿Cómo funciona un algoritmo?

Los algoritmos trabajan con entrada, procesamiento y salida de información:

Entrada: Reciben datos (por ejemplo, una búsqueda en Google).

Procesamiento: Analizan la información y aplican reglas establecidas.

Salida: Devuelven un resultado (como una lista de páginas relevantes para la búsqueda).

Ejemplo práctico:

Algoritmo de búsqueda de palabras en un texto

1. Recibe una palabra clave.

2. Compara la palabra con el contenido del texto.

3. Devuelve las frases que contienen la palabra.

Este es el principio detrás de los motores de búsqueda y muchos programas informáticos.

¿Para qué sirven los algoritmos?

Los algoritmos tienen aplicaciones en numerosos campos, entre ellos:

Tecnología: Son la base de aplicaciones y software.

Inteligencia Artificial: Permiten a las máquinas aprender patrones y tomar decisiones.

Seguridad Informática: Protegen sistemas mediante cifrado y autenticación.

Medicina: Ayudan en el diagnóstico de enfermedades y análisis de datos clínicos.

Economía y Finanzas: Procesan información para detectar tendencias y riesgos.

Cada tarea que realiza un sistema informático, desde calcular una ruta hasta procesar una imagen, depende de un algoritmo.

La importancia de los algoritmos

Los algoritmos son cruciales porque:

Aumentan la eficiencia: Permiten realizar cálculos y tareas complejas en segundos.

Automatizan procesos: Reducen la necesidad de intervención humana.

Optimizan recursos: En negocios y tecnología, mejoran el rendimiento de sistemas.

Facilitan la toma de decisiones: Ayudan en sectores como finanzas y medicina a interpretar grandes volúmenes de datos.

Sin algoritmos, la informática moderna y la inteligencia artificial no podrían existir.

Los algoritmos en la redes sociales y buscadores

Los algoritmos en redes sociales y buscadores son complejos sistemas diseñados para analizar información y mostrar contenido relevante a cada usuario. Aunque funcionan de manera distinta, comparten el mismo objetivo: ordenar y priorizar la información según la relevancia y el comportamiento del usuario.

Algoritmos en redes sociales

Las plataformas como Facebook, Instagram, TikTok y Twitter utilizan algoritmos para decidir qué contenido aparece en el feed de cada usuario. Su funcionamiento se basa en factores como:

Interacción del usuario: Si das «me gusta», comentas o compartes ciertos tipos de publicaciones, el algoritmo te mostrará contenido similar.

Tiempo de visualización: Si pasas más tiempo viendo un video o leyendo un post, la plataforma interpreta que te interesa ese tipo de contenido y te lo recomendará más.

Popularidad del contenido: Publicaciones con muchas interacciones suelen ser priorizadas y mostradas a más personas.

Temas y preferencias: La inteligencia artificial analiza qué tipo de páginas sigues, qué hashtags usas y con qué personas interactúas para sugerirte publicaciones afines.

Ubicación y tendencias: Algunas redes sociales ajustan el contenido según la ubicación del usuario o los temas más comentados en su región.

Ejemplo: Si ves muchos videos sobre viajes en TikTok, la plataforma ajustará tu feed para mostrar más contenido de turismo.

Algoritmos en Buscadores (Google, Bing, etc.)

Los motores de búsqueda utilizan algoritmos para ordenar y clasificar millones de páginas web en fracciones de segundo. Su funcionamiento se basa en:

Palabras clave: El algoritmo analiza qué palabras escribes en la búsqueda y busca coincidencias con páginas en la web.

Relevancia del contenido: Google y otros buscadores valoran qué tan útil es una página según la calidad de la información y la estructura del sitio.

Autoridad de la fuente: Las páginas con más visitas, enlaces y buena reputación aparecen en los primeros resultados.

Experiencia del usuario: Factores como tiempo de carga, diseño adaptable a móviles y facilidad de lectura influyen en el ranking de resultados.

Ubicación y contexto: Los resultados pueden variar según el país o ciudad en donde te encuentres, adaptándose a información más relevante para ti.

Ejemplo: Si buscas «mejor café en Ámsterdam», el algoritmo analizará páginas con reseñas, mapas y recomendaciones locales para mostrarte los lugares más relevantes.

Podemos deducir entonces que los algoritmos en redes sociales y buscadores están diseñados para predecir qué contenido te interesará más y mostrarte información personalizada. Son fundamentales para el funcionamiento de internet y la manera en que consumimos contenido en el mundo digital.

Otras aplicaciones reales de los algoritmos

Los algoritmos se usan en todos los aspectos de la tecnología moderna. Algunos ejemplos:

Publicidad digital: Optimizan anuncios personalizados según los intereses de los consumidores.

Vehículos autónomos: Analizan datos en tiempo real para conducir sin intervención humana.

E-commerce: Predicen tendencias de compra y optimizan precios en tiendas en línea.

Los algoritmos están revolucionando la forma en que interactuamos con la tecnología y el mundo digital.

La arquitectura lógica que sostiene la innovación

Los algoritmos son el motor detrás de la informática moderna, permitiendo desde búsquedas en internet hasta la inteligencia artificial. Su importancia radica en la eficiencia, automatización y optimización de procesos en diversas industrias. A medida que la tecnología avanza, los algoritmos continúan evolucionando, impulsando innovaciones y mejorando la forma en que las computadoras procesan la información.

Modelos Generativos: Qué son y sus aplicaciones en la Inteligencia Artificial

Los modelos generativos son un tipo de inteligencia artificial capaz de crear contenido nuevo a partir de patrones aprendidos en grandes volúmenes de datos. Estos modelos han revolucionado múltiples industrias, desde la creatividad digital hasta la investigación científica, permitiendo generar imágenes, textos, música y hasta estructuras moleculares.

¿Qué son los Modelos Generativos?

Los modelos generativos son algoritmos de aprendizaje automático que no solo analizan datos, sino que también pueden crear nuevos datos con características similares a los originales.

Ejemplo: Un modelo generativo entrenado con miles de imágenes de paisajes puede generar nuevas imágenes de paisajes que nunca han existido antes.

Funcionamiento: Utilizan redes neuronales avanzadas como GANs (Redes Generativas Adversarias) y VAEs (Autoencoders Variacionales) para aprender patrones y generar contenido realista.

Aplicaciones de los Modelos Generativos

Creación de contenido digital

Los modelos generativos pueden producir imágenes, videos y textos de manera autónoma.

Ejemplo: Herramientas como DALL·E generan ilustraciones a partir de descripciones textuales.

Desarrollo de fármacos y ciencia

Ayudan a diseñar nuevas estructuras moleculares para medicamentos.

Ejemplo: Investigadores usan IA generativa para descubrir compuestos químicos con potencial terapéutico.

Generación de datos sintéticos

Crean datos artificiales para entrenar modelos sin comprometer la privacidad.

Ejemplo: Empresas generan datos sintéticos para mejorar la precisión de algoritmos sin usar información real de usuarios.

Asistentes virtuales y chatbots

Los modelos generativos permiten respuestas más naturales y fluidas en asistentes de IA.

Ejemplo: ChatGPT usa modelos generativos para mantener conversaciones coherentes y útiles.

Diseño y arte

Facilitan la creación de obras artísticas digitales basadas en estilos predefinidos.

Ejemplo: Artistas usan IA para generar pinturas inspiradas en Van Gogh o Picasso.

Desafíos y futuro de los Modelos Generativos

A pesar de sus avances, los modelos generativos enfrentan desafíos como:

Ética y privacidad → Generación de contenido falso o manipulado.

Consumo de recursos → Requieren grandes cantidades de datos y energía para entrenarse.

Control de calidad → No siempre producen resultados precisos o útiles.

El futuro de los modelos generativos apunta a una mayor integración en la vida cotidiana, desde la educación hasta la automatización de tareas creativas.

La nueva frontera de la creatividad digital

Los modelos generativos han transformado la manera en que interactuamos con la tecnología, permitiendo la creación de contenido innovador y soluciones avanzadas en múltiples sectores. A medida que evolucionan, su impacto seguirá creciendo, redefiniendo industrias y mejorando la eficiencia en diversas áreas.

Aprendizaje Profundo (Deep Learning): La base de la evolución de la IA

El aprendizaje profundo (deep learning) es una rama de la inteligencia artificial que permite a las máquinas procesar información de manera avanzada, imitando el funcionamiento del cerebro humano mediante redes neuronales artificiales. Su capacidad para analizar grandes volúmenes de datos y detectar patrones complejos lo ha convertido en una tecnología clave en múltiples sectores.

¿Qué es el Aprendizaje Profundo?

El aprendizaje profundo es un subcampo del aprendizaje automático (machine learning) que utiliza redes neuronales profundas para procesar información de manera autónoma.

Basado en redes neuronales → Modelos con múltiples capas que simulan el razonamiento humano.

Procesamiento de datos masivos → Aprende de grandes volúmenes de información sin intervención humana.

Adaptación y mejora continua → Ajusta sus parámetros con cada nueva entrada de datos.

Características claves del Aprendizaje Profundo

Estructura en capas

Los modelos de aprendizaje profundo utilizan redes neuronales multicapa, donde cada nivel refina la información antes de enviarla a la siguiente capa.

Ejemplo: En reconocimiento facial, una capa detecta bordes, otra formas y otra identifica rostros completos.

Aprendizaje autónomo

A diferencia de otros modelos, el aprendizaje profundo no necesita reglas predefinidas, sino que aprende por sí mismo a partir de datos.

Ejemplo: Un sistema de IA puede aprender a traducir idiomas sin que se le enseñen reglas gramaticales explícitas.

Procesamiento de datos no estructurados

Puede analizar información en formatos variados, como imágenes, texto y audio, sin necesidad de etiquetado previo.

Ejemplo: Algoritmos de IA pueden identificar objetos en fotos sin que hayan sido previamente categorizados.

Uso de grandes volúmenes de datos

Cuanto más datos procesa, mejor se vuelve en la identificación de patrones y toma de decisiones.

Ejemplo: Sistemas de recomendación como Netflix analizan miles de preferencias para sugerir contenido personalizado.

Diferencias entre Aprendizaje Profundo y Aprendizaje Automático

| Aspecto | Aprendizaje Automático | Aprendizaje Profundo |

| Intervención humana | Necesita ajustes manuales | Aprende de forma autónoma |

| Tipo de datos | Datos estructurados | Datos no estructurados |

| Complejidad | Modelos más simples | Redes neuronales avanzadas |

| Capacidad de adaptación | Limitada | Alta, mejora con más datos |

La evolución hacia una inteligencia multinivel

El aprendizaje profundo es una tecnología revolucionaria que permite a las máquinas aprender y mejorar sin intervención humana, procesando datos de manera avanzada. Su capacidad para detectar patrones complejos y adaptarse a nuevas situaciones lo convierte en una herramienta clave en el desarrollo de la inteligencia artificial.

Red Neuronal Convolucional (CNN): Cómo funciona y sus aplicaciones en IA

Las Redes Neuronales Convolucionales (Convolutional Neural Network – CNN) son un tipo de arquitectura de aprendizaje profundo diseñada específicamente para procesar datos con estructura de cuadrícula, como imágenes. Su capacidad para detectar patrones visuales ha revolucionado áreas como la visión por computadora, el reconocimiento facial y la conducción autónoma.

¿Qué es una Red Neuronal Convolucional?

Una CNN es un modelo de inteligencia artificial que imita el funcionamiento del sistema visual humano. Se compone de varias capas que procesan imágenes de manera progresiva, extrayendo características desde bordes simples hasta estructuras complejas.

Inspiración biológica → Basada en la corteza visual del cerebro humano.

Procesamiento jerárquico → Identifica patrones desde lo más simple hasta lo más detallado.

Uso en imágenes y datos estructurados → Aplicada en reconocimiento facial, diagnóstico médico y más.

Arquitectura de una CNN

Las CNN están compuestas por varias capas especializadas:

Capas convolucionales → Aplican filtros a la imagen para detectar características.

Capas de pooling → Reducen la dimensionalidad de los datos, mejorando la eficiencia.

Capas completamente conectadas → Transforman las características extraídas en decisiones finales.

Ejemplo: En reconocimiento facial, las primeras capas detectan bordes, las intermedias identifican formas y las últimas reconocen rostros completos.

Aplicaciones de las Redes Neuronales Convolucionales

Visión por computadora

Las CNN permiten que las máquinas interpreten imágenes con precisión.

Ejemplo: Sistemas de seguridad que identifican rostros en tiempo real.

Diagnóstico médico

Se usan para analizar imágenes médicas y detectar enfermedades.

Ejemplo: Algoritmos que identifican tumores en radiografías.

Conducción autónoma

Ayudan a los vehículos a reconocer señales de tráfico y obstáculos.

Ejemplo: Autos autónomos que detectan peatones y reaccionan en consecuencia.

Procesamiento de lenguaje natural

Aunque su enfoque principal es la visión, también se aplican en análisis de texto.

Ejemplo: Modelos que identifican emociones en comentarios escritos.

Desafíos y futuro de las CNN

A pesar de sus avances, las CNN enfrentan desafíos como:

Consumo de recursos → Requieren grandes cantidades de datos y potencia computacional.

Sobreajuste → Pueden aprender patrones irrelevantes si no se entrenan correctamente.

Ética y privacidad → Su uso en reconocimiento facial plantea preocupaciones legales.

El futuro de las CNN apunta a modelos más eficientes y accesibles, con aplicaciones en inteligencia artificial general y automatización avanzada.

El futuro de la visión y la interpretación visual

Las Redes Neuronales Convolucionales han transformado la manera en que las máquinas procesan imágenes y datos visuales, permitiendo avances en múltiples industrias. A medida que evolucionan, su impacto seguirá creciendo, redefiniendo sectores como la salud, la seguridad y la tecnología.

Superinteligencia Artificial (ASI): El horizonte más ambicioso de la IA

La Superinteligencia Artificial (ASI, por sus siglas en inglés) representa el nivel más avanzado y teórico de la inteligencia artificial, un estado donde las capacidades de la IA no solo igualan, sino que superan la inteligencia humana en todos los aspectos. Este concepto, que una vez perteneció únicamente al ámbito de la ciencia ficción, se ha convertido en un tema crucial de debate dentro de la comunidad tecnológica y filosófica.

En este artículo, exploraremos qué significa la ASI, qué implicaciones conlleva, cómo se posiciona dentro del espectro de la IA, sus posibles aplicaciones y su relevancia para el futuro de la humanidad.

¿Qué es la Superinteligencia Artificial (ASI)?

La Superinteligencia Artificial se define como un sistema de inteligencia artificial capaz de superar la inteligencia humana en todos los aspectos relevantes, incluida la creatividad, la resolución de problemas complejos, el aprendizaje y las habilidades sociales. A diferencia de la Inteligencia Artificial General (AGI), que aspira a igualar las capacidades humanas, la ASI trasciende las limitaciones humanas, logrando un nivel de inteligencia y conocimiento incomparable.

Un sistema ASI no estaría limitado por factores humanos como el tiempo, la capacidad de aprendizaje o los sesgos emocionales, lo que le permitiría encontrar soluciones innovadoras a problemas globales en tiempos récord.

¿Qué implica el desarrollo de la ASI?

El desarrollo de la ASI presenta un abanico de implicaciones que abarcan los ámbitos técnico, social, ético y filosófico. Estas son algunas de las principales:

Implicaciones técnicas

Procesamiento ilimitado: La ASI requeriría una capacidad de computación casi infinita para analizar datos, aprender y ejecutar tareas en múltiples dominios al mismo tiempo.

Evolución autónoma: Una ASI tendría la capacidad de mejorar sus propios algoritmos, creando un ciclo de autoaprendizaje exponencial.

Innovación constante: Sería capaz de generar avances científicos y tecnológicos más rápido de lo que cualquier humano o equipo podría lograr.

Implicaciones sociales y éticas

Riesgo de descontrol: Si no se diseñan con estrictas medidas de control, una ASI podría actuar en contra de los intereses humanos.

Desigualdad social: El acceso a una ASI podría exacerbar las brechas entre naciones y empresas, generando desigualdad en el poder.

Impacto en el trabajo y la economía: Podría automatizar incluso las tareas más complejas, redefiniendo la economía global y los roles humanos.

Consciencia ética: Existe el debate sobre si una ASI debería tener valores morales o derechos propios.

¿Qué parte del ecosistema de la IA representa?

En el espectro de la inteligencia artificial, la ASI representa el nivel más ambicioso y avanzado. Este es el mapa del progreso tecnológico dentro del ecosistema de la IA:

Inteligencia Artificial Estrecha (Narrow AI): Especializada en realizar tareas específicas, como los asistentes virtuales o el reconocimiento facial.

Inteligencia Artificial General (AGI): Capaz de comprender y razonar en múltiples dominios, imitando la inteligencia humana.

Superinteligencia Artificial (ASI): Un nivel teórico donde la IA supera a la inteligencia humana en todos los aspectos.

Mientras que la AGI todavía está en proceso de investigación, la ASI es un ideal futuro cuya implementación dependerá del progreso y control adecuados.

¿Dónde se podría aplicar la ASI?

La ASI, de desarrollarse, tendría aplicaciones casi ilimitadas y revolucionaría todos los sectores. Algunos ejemplos posibles incluyen:

Salud y medicina

Desarrollo instantáneo de curas para enfermedades complejas como el cáncer o el Alzheimer.

Optimización del sistema sanitario a escala global, asegurando acceso universal a tratamientos.

Simulaciones avanzadas para entender y prevenir pandemias.

Ciencia e investigación

Solución de problemas científicos complejos, como el cambio climático y la energía renovable.

Descubrimientos revolucionarios en física, biología y otras disciplinas.

Exploración espacial avanzada, como la colonización de planetas.

Economía y negocios

Creación de estrategias empresariales perfectas y sostenibles.

Optimización de recursos naturales y económicos a nivel mundial.

Automatización total de procesos industriales y comerciales.

Ética y gobernanza global

Propuestas para una gobernanza global justa y eficiente basada en datos.

Resolución de conflictos internacionales con soluciones imparciales.

Regulación de sistemas complejos, como el comercio global y los derechos humanos.

Importancia de la Superinteligencia Artificial

La ASI podría ser un punto de inflexión en la historia de la humanidad. Su importancia radica en:

Avances sin precedentes: La ASI podría resolver problemas que hoy parecen insuperables.

Impacto transformador: Su desarrollo podría redefinir la economía, la política y la sociedad.

Responsabilidad humana: La gestión adecuada de la ASI podría maximizar sus beneficios mientras se mitigan sus riesgos.

Sin embargo, su potencial también implica riesgos significativos si no se desarrollan marcos éticos y de control adecuados.

Reflexiones ante un punto de inflexión histórico

La Superinteligencia Artificial (ASI) no es solo un concepto tecnológico, sino un desafío existencial para la humanidad. Su desarrollo plantea preguntas fundamentales sobre nuestra relación con la tecnología, nuestros valores y nuestro futuro como especie.

Aunque la ASI ofrece la promesa de un mundo más eficiente, justo y avanzado, también podría convertirse en un riesgo sin precedentes si no se gestiona con cuidado. El camino hacia la ASI debe estar guiado por la colaboración global, la ética y el compromiso con un uso responsable de la tecnología.

La pregunta no es si podemos desarrollar la ASI, sino si estamos preparados para gestionarla de manera segura y equitativa cuando llegue.

Redes Neuronales Artificiales (ANN): La base del poder creativo de la IA

Las redes neuronales son una de las tecnologías más revolucionarias dentro del campo de la inteligencia artificial (IA) y el aprendizaje automático (Machine Learning). Inspiradas en el funcionamiento del cerebro humano, estas estructuras computacionales han permitido resolver problemas complejos que antes parecían inalcanzables. Desde el reconocimiento facial hasta los asistentes virtuales, las redes neuronales están en el núcleo de muchas innovaciones modernas. En este artículo, exploraremos qué son, cómo funcionan, sus aplicaciones y su impacto en el mundo.

¿Qué son las Redes Neuronales?

Las redes neuronales son sistemas computacionales diseñados para imitar el comportamiento de las neuronas en el cerebro humano. Están formadas por capas de nodos (también llamados neuronas artificiales) conectados entre sí. Cada nodo recibe datos, realiza cálculos y envía resultados a las neuronas de la siguiente capa, permitiendo el procesamiento de información compleja.

Las redes neuronales se dividen en tres tipos principales de capas:

Capa de entrada: Donde ingresan los datos iniciales al sistema.

Capas ocultas: Procesan y analizan los datos mediante cálculos matemáticos complejos.

Capa de salida: Genera el resultado final basado en los datos procesados.

¿Cómo funcionan las Redes Neuronales?

El funcionamiento de las redes neuronales se basa en el entrenamiento mediante datos. Este proceso implica:

Entrada de datos: Los datos iniciales pasan a través de la capa de entrada.

Pesos y sesgos: Cada conexión entre neuronas tiene un «peso» que determina su importancia. Los sesgos ayudan a ajustar las predicciones.

Función de activación: Una fórmula matemática que decide si una neurona se activa y envía información a la siguiente capa.

Optimización: Mediante técnicas como el algoritmo de backpropagation, las redes ajustan los pesos para reducir los errores en las predicciones.

Tipos de Redes Neuronales

Aparte de la ANN, existen otros tipos de redes neuronales, dependiendo del problema que se desee resolver:

Redes Neuronales Artificiales (ANN): La forma más básica, utilizada para tareas generales como clasificación y predicción.

Redes Neuronales Convolucionales (CNN): Especializadas en procesamiento de imágenes y reconocimiento visual.

Redes Neuronales Recurrentes (RNN): Diseñadas para trabajar con datos secuenciales, como texto o series temporales.

Autoencoders: Usados para la reducción de dimensionalidad y compresión de datos.

Redes Generativas Antagónicas (GAN): Generan contenido nuevo a partir de patrones aprendidos.

Aplicaciones de las Redes Neuronales

Las redes neuronales tienen un amplio rango de aplicaciones en diversas industrias:

Reconocimiento de imágenes y video: Identificación de objetos, personas y escenarios.

Procesamiento de Lenguaje Natural (NLP): Traducciones automáticas, asistentes virtuales y análisis de sentimientos.

Diagnóstico médico: Análisis de imágenes médicas como rayos X o resonancias magnéticas.

Predicciones financieras: Análisis de tendencias y predicciones de precios de activos.

Vehículos autónomos: Detección de obstáculos y toma de decisiones en tiempo real.

Creación de contenidos: Generación de imágenes, videos y música originales.

Ventajas y desafíos

Ventajas

Capacidad de procesar datos masivos y complejos.

Alta precisión en tareas específicas como reconocimiento de patrones.

Potencial para innovar y resolver problemas en múltiples áreas.

Desafíos

Requiere una gran cantidad de datos y poder computacional para entrenar los modelos.

Puede ser difícil de interpretar (fenómeno conocido como «caja negra»).

Riesgos de sesgo en los datos, lo que afecta la equidad de los resultados.

El corazón latente de la tecnología moderna

Las redes neuronales son el corazón de muchas innovaciones actuales en inteligencia artificial. Su capacidad para aprender y adaptarse las hace indispensables en un mundo donde los datos crecen exponencialmente. Sin embargo, a medida que estas tecnologías avanzan, también es fundamental abordar los desafíos éticos y técnicos que enfrentan. El futuro de las redes neuronales es prometedor y continuará transformando la forma en que vivimos, trabajamos y entendemos el mundo.

Conclusión General

La travesía por el ecosistema de la IA nos revela que no estamos ante una herramienta aislada, sino ante una evolución del pensamiento computacional. La integración de estos conceptos demuestra que la verdadera potencia de la tecnología reside en su capacidad para aprender, predecir y crear. El reto del mañana no será solo técnico, sino profundamente humano: liderar esta transición con ética y responsabilidad para asegurar que la inteligencia artificial sea el mayor aliado de nuestra especie, en Herramientas Digitales, estaremos atentos a ayudarte en ese aprendizaje contínuo.